Masalah kebocoran data umumnya terjadi secara disengaja maupun tidak disengaja. Apesnya, salah satu peneliti AI Microsoft secara tidak sengaja membocorkan data internal yang jumlahnya sampai menyentuh 38 Terabyte. Waduh, kok bisa kejadian yah, brott?

Peneliti AI Microsoft Tidak Sengaja Membocorkan Data Internal

Insiden di mana peneliti AI Microsoft tak sengaja membocorkan data internal yang jumlahnya sampai 38 Terabyte ini terjadi pada hari Senin (18/9), di mana kebocoran tersebut benar-benar tidak disengaja dan baru diketahui oleh sang peneliti beberapa waktu setelahnya, setidaknya berdasarkan temuan tim WIZ Research.

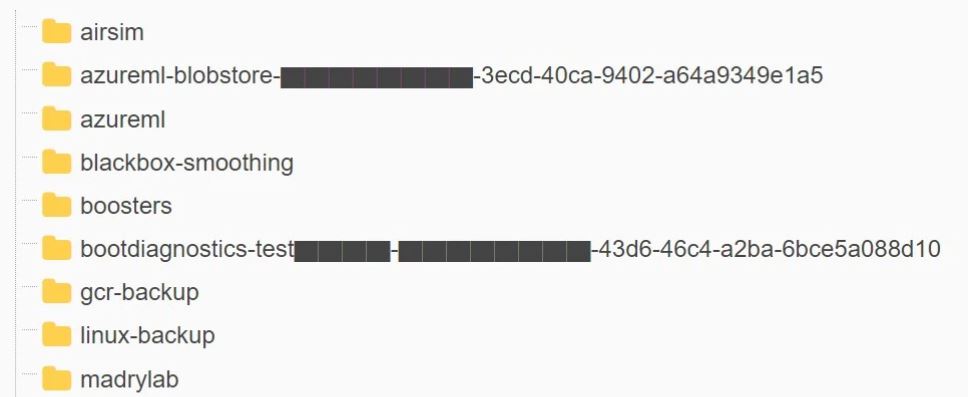

Kebocoran puluhan Terabyte data internal tersebut ditemukan di repositori AI GitHub raksasa Microsoft bernama “robust-models-transfer” yang telah dipublikasikan secara tidak sengaja oleh peneliti AI Microsoft saat mengirimkan data pelatihan open-source.

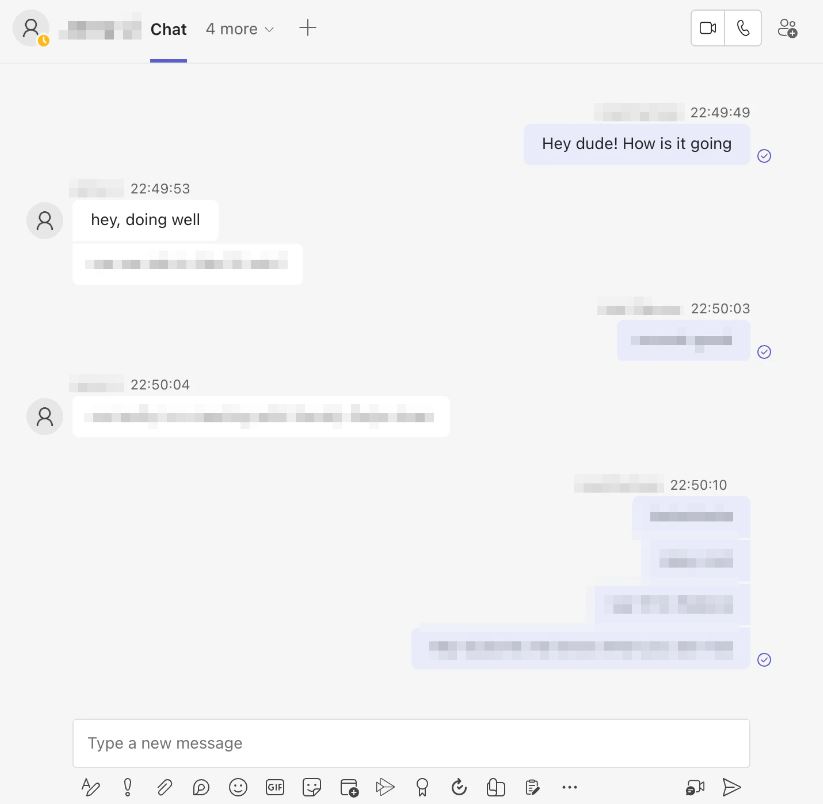

Data sebesar 38 Terabyte yang bocor tersebut setidaknya berisikan sekitar 30.000 percakapan antar karyawan di perusahaan tersebut, internal, kunci, termasuk kata sandi. Bahkan, di antara sekumpulan data yang bocor tersebut juga berisikan data internal semacam paper terkait penelitian model ImageNet yang ideal.

Terkait kebocoran puluhan Terabyte data yang bocor tersebut, pihak Microsoft katakan bahwa ini semua dikarenakan salah satu fitur di Microsoft Azure bernama token Shared Access Signature (SAS) diklaim terlalu permisif. Parahnya lagi, file README.md juga memiliki instruksi dan akses ke seluruh akun dan penyimpanan.

Microsoft Jamin Tidak Ada Kebocoran Data

Menanggapi temuan tim WIZ Research, baru-baru ini Microsoft klaim dan memberikan jaminan bahwa tidak ada kebocoran data yang terjadi. Klaim berani tersebut berdasarkan tidak adanya layanan internal yang terdampak karena insiden tersebut, sama halnya para user yang tidak perlu takut data internalnya tersebar.

Hal ini dikarenakan Microsoft telah resmi mencabut token SAS dan memblokir semua akses eksternal ke akun penyimpanan yang telah diselesaikan dua hari setelah klarifikasi dari pihak Microsoft.

Waduh, semoga benar tidak ada data pribadi yang bocor yah, brott!

Baca juga informasi menarik Gamebrott lainnya terkait Tech atau artikel lainnya dari Bima. For further information and other inquiries, you can contact us via author@gamebrott.com